KI-Hype vs. Realität Warum ChatGPT deinen Lieferwagen nicht routen sollte (und was du stattdessen brauchst)

Kurze Zusammenfassung

Künstliche Intelligenz ist weit mehr als nur ein Trend, erfordert aber einen realistischen Blick auf Einsatzmöglichkeiten und Grenzen. In diesem Beitrag lernst du, wie du echte Potenziale von leeren Versprechen unterscheiden und KI sinnvoll im Unternehmen einsetzt.

Neben der Einordnung erfährst du:

- Welche Branchen aktuell am stärksten von KI-Integrationen profitieren

- Warum Datenqualität die wichtigste Voraussetzung für den Erfolg ist

- Wie du zwischen generativer KI und spezialisierten Algorithmen unterscheidest

- Welche ethischen und rechtlichen Fragen bei der Nutzung beachtet werden müssen

- Wie du eine KI-Strategie entwickelst, die langfristig echten Mehrwert bietet

Einführung

Der Hype um Generative KI ist riesig. Viele Unternehmen verfallen aktuell in einen Aktionismus: „Wir brauchen eine KI-Strategie!“ Doch wer versucht, jedes geschäftliche Problem mit einem Large Language Model (LLM) zu lösen, steht schnell vor teuren Enttäuschungen.

Bei cube vision gilt der Grundsatz: Technologie folgt dem Prozess, nicht umgekehrt.

Um echte Effizienzgewinne zu erzielen, müssen wir zunächst die Begriffe sortieren. Denn nicht alles, was „denkt“, ist ein LLM – und oft ist ein klassischer Algorithmus oder ein gezieltes ML-Modell die weitaus klügere Wahl.

Der Technologie-Baukasten:

Eine Einordnung

Nicht alles ist ChatGPT:

Einordnung der Technologien

Um die richtige Lösung für dein Unternehmen zu finden, lohnt sich ein Blick unter die Haube. Die Entwicklung lässt sich als Evolution verstehen:

1. Der Algorithmus

(Das Regelwerk)

Die Basis. Hier schreibt ein Entwickler den Lösungsweg explizit vor. Es ist reine Logik, die strikten Anweisungen folgt: „Wenn X passiert, dann tue Y.“

Charakteristik: Deterministisch. Der Mensch definiert den Weg.

Beispiel: Eine Excel-Formel oder ein Skript, das Dateien umbenennt.

2. Machine Learning / ML

(Das Modell ist der Algorithmus)

Hier findet ein Paradigmenwechsel statt. Der:die Entwickler:in schreibt keinen Algorithmus mehr, der das Problem löst. Stattdessen definiert er ein Trainingsverfahren und füttert das System mit Daten. Das System lernt die Zusammenhänge selbst und erstellt ein Modell. Dieses Modell ersetzt den klassischen Algorithmus: Du gibst einen Input hinein, und das Modell liefert wie eine „Blackbox“ den Output, basierend auf dem Gelernten.

Dabei gibt es große Unterschiede in der Komplexität:

- Entscheidungsbäume: Diese sind oft noch transparent. Man kann nachvollziehen, warum das Modell „Ja“ oder „Nein“ gesagt hat (z. B. „Kunde ist über 50“ UND „Kunde wohnt in PLZ-Gebiet X“).

- Neuronale Netze: Wenn die Zusammenhänge komplexer werden, nutzt man Strukturen, die dem Gehirn nachempfunden sind.

3. Deep Learning

(Die Tiefe der Netze)

Deep Learning ist im Grunde Machine Learning mit sehr komplexen und vielschichtigen (tiefen) neuronalen Netzen. Man kann sich das wie die technische Nachahmung des menschlichen Gehirns vorstellen.

So funktioniert das „Gehirn“ des Computers: Ein neuronales Netz besteht aus unzähligen Knotenpunkten (Neuronen) und Verbindungen. Jeder dieser Knotenpunkte funktioniert im Kleinen fast wie ein eigener Entscheidungsfilter: Er empfängt Signale, gewichtet diese und entscheidet dann – ähnlich wie eine Schranke –, ob und wie stark das Signal an die nächsten Knoten weitergeleitet wird.

Der Vorteil der Komplexität: Der Unterschied zum klassischen Entscheidungsbaum ist die enorme Dichte der Informationen:

- Während ein Baum meist lineare Pfade verfolgt, sind neuronale Netze ein riesiges Geflecht.

- Sie haben unzählige Eingangs- und Ausgangsverbindungen, können Schleifen (Loops) enthalten und verarbeiten Informationen in vielen übereinanderliegenden Schichten („Deep“)

- Genau durch diese vielschichtige Struktur sind sie in der Lage, hochkomplexe Sachverhalte mit tausenden von Parametern zu entscheiden. So können sie selbstständig Merkmale in unstrukturierten Daten erkennen (z. B. Pixelmuster in Bildern), ohne dass ein Mensch diese Regeln vorher definieren muss.

Das „Blackbox“-Phänomen: Diese Leistungsfähigkeit hat jedoch einen Preis: Die mangelnde Transparenz. Wie bei einem klassischen Algorithmus oder einem Entscheidungsbaum gibt man eine Aufgabenstellung hinein und erhält eine Antwort. Der Weg dorthin unterscheidet sich jedoch fundamental:

Bei einem Algorithmus oder Entscheidungsbaum lässt sich jeder Schritt genau nachvollziehen und ggf. anpassen. Man weiß genau, warum ein bestimmter Output erzeugt wurde.

Bei einem Deep Learning-Netzwerk ist das oft unmöglich. Durch die Millionen von gewichteten Verbindungen und Schichten lässt sich im Nachhinein kaum erklären, warum das Netz genau diesen Output geliefert hat.

Man spricht daher oft von einer Blackbox: Man sieht den Input und den Output, aber die internen Entscheidungsprozesse bleiben im Dunkeln. Das Ergebnis ist oft extrem präzise, aber der Weg der Entscheidungsfindung ist für den Menschen nicht mehr intuitiv nachvollziehbar. Es gibt zwar Ansätze wie Explainable AI, die versuchen, diese Prozesse transparenter zu machen, doch die grundlegende Komplexität bleibt eine Herausforderung.

4. Large Language Models / LLMs (Der Sprach-Spezialist)

Hier schließt sich der Kreis. Ein LLM ist eine spezielle Anwendung von Deep Learning, die ausschließlich auf Sprache trainiert wurde. Es ist ein gigantisches neuronales Netz, das „das Internet gelesen“ hat. Seine Stärke ist nicht Logik oder Faktenwissen, sondern Wahrscheinlichkeit. Es berechnet basierend auf seinem Training, welches Wort in einem Satz statistisch gesehen als nächstes folgen müsste.

Das erklärt auch, warum man ChatGPT und Co. von Natur aus nicht zum zuverlässigen Rechnen nutzen sollte. Ein LLM „rechnet“ nicht, sondern es ergänzt Text. Wenn es „2 + 2 = 4“ schreibt, dann nicht, weil es addiert hat, sondern weil diese Zeichenfolge statistisch oft beieinander steht. Es hat kein echtes Verständnis von Zahlen, Mathematik oder von Raum und Zeit.

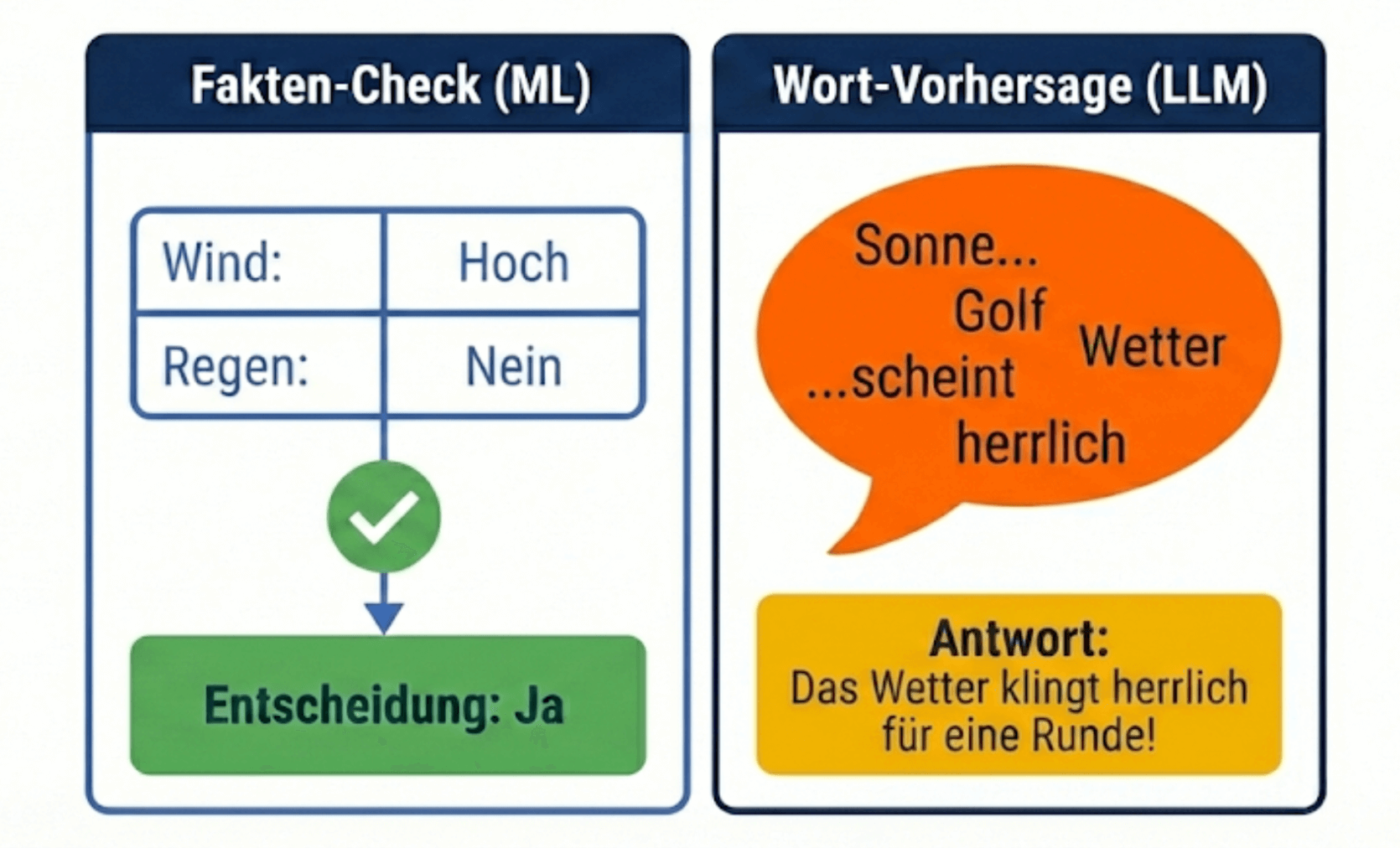

Das Golf-Beispiel:

Der Unterschied zwischen Wissen und Raten

Um zu verstehen, wann du welches System einsetzen solltest, hilft ein einfaches Szenario: „Kann ich heute Golf spielen?“

Der Ansatz von klassischem ML

(z. B. Entscheidungsbaum)

Ein ML-Modell wurde mit historischen Wetterdaten trainiert (Wind, Temperatur, Regen -> Golf: Ja/Nein).

- Wie es arbeitet: Es prüft die aktuellen Werte (Input) gegen die gelernten Regeln im Modell.

- Das Ergebnis: Eine präzise Entscheidung („Ja“ oder „Nein“).

- Der Vorteil: Es ist faktisch, schnell und halluziniert nicht. Bei einem Entscheidungsbaum könntest du sogar genau sehen, an welcher Wetter-Variable es gescheitert ist.

Der Ansatz eines Large Language Models (LLM)

Das LLM hat keine Tabelle im Kopf, sondern Millionen von Texten über Golf gelesen.

- Wie es arbeitet: Es analysiert deine Frage sprachlich und ergänzt die wahrscheinlichste Wortfolge. Es „denkt“: Auf die Wörter ‚Sonne‘ und ’20 Grad‘ folgt in Texten meistens eine positive Antwort.

- Das Ergebnis: „Ja, das Wetter klingt herrlich für eine Runde! Vergessen Sie die Sonnencreme nicht.“

Das Risiko: Wenn du es nach komplexer Logik fragst (z.B. „Berechne die exakte Flugbahn bei 35 km/h Seitenwind“), könnte es plausibel klingenden Unsinn erzählen („Halluzination“), weil es Wörter zusammensetzt, aber nicht physikalisch rechnet.

Praxis-Check: Welches KI-Werkzeug für welchen Prozess?

Was bedeutet das für deine Unternehmensprozesse? Hier sind drei Beispiele, die zeigen, warum wir bei cube vision genau hinschauen, bevor wir eine Technologie empfehlen.

1. Die Routenplanung (Logik schlägt Sprache)

Die Aufgabe: 20 Haltepunkte sollen optimal auf 3 Tage und mehrere Fahrzeuge verteilt werden.

- Falsch (LLM): Ein Sprachmodell würde eine Route „raten“, die gut klingt, aber den Fahrer im Zickzack durch die Stadt schickt. LLMs haben kein Verständnis von Raum und Zeit.

- Richtig (Algorithmus): Hier nutzen wir Operations Research (Solver). Ein mathematischer Algorithmus berechnet aus Milliarden Optionen die eine beweisbar beste Route. Das spart Sprit und Zeit.

2. Auftragsbestätigungen auslesen (Sprache schlägt Logik)

Die Aufgabe: Daten (Bestellnummer, Preise) aus PDFs extrahieren, wobei jeder Lieferant ein anderes Layout nutzt.

- Falsch (Starrer Algorithmus): Früher scheiterten Systeme, wenn die Bestellnummer plötzlich einen Zentimeter weiter links stand.

- Richtig (LLM / Deep Learning): Hier glänzt die moderne KI. Sie versteht den Kontext. Sie weiß, dass eine Zahl neben dem Wort „Total“ der Gesamtbetrag ist – egal wo sie steht. Hier nutzen wir die „menschliche“ Auffassungsgabe der KI zur Automatisierung.

3. Massenverarbeitung von Rechnungen (Effizienz zählt)

Die Aufgabe: 10.000 Eingangsrechnungen pro Monat verarbeiten.

Die Lösung: Ein spezialisiertes Document-AI-Modell. Ein riesiges LLM wäre hier zu teuer und energieintensiv. Spezialisierte Modelle (oft auf Deep Learning basierend) sind schneller, kosteneffizienter und genauer als ein allgemeiner Chatbot.

Die cube vision Philosophie: Ganzheitlich, Sicher, Nachhaltig

Bei cube vision erleben wir oft, dass Unternehmen den zweiten Schritt vor dem ersten machen wollen. Ein LLM kann keine guten Entscheidungen treffen, wenn die Datenbasis fehlt oder die Prozesse nicht definiert sind. Unsere Philosophie stützt sich auf drei Säulen:

1. Ganzheitliche Digitalisierung statt Inseln

Digitalisierung muss von Anfang an ganzheitlich gedacht werden. Wer heute kleine, isolierte Lösungen baut, muss morgen oft alles mit hohem Aufwand neu unter einen Hut bringen. Daten sind das Fundament. Das Aufbrechen von Datensilos sorgt nicht nur für bessere Reports und Entscheidungen, sondern ist die zwingende Voraussetzung, um KI überhaupt sinnvoll einzusetzen.

2. IT-Sicherheit & Datenschutz als Design-Prinzip

Sicherheit ist kein Add-on, sondern die Basis. Wir bewerten Systeme nach klaren Kriterien: Verfügbarkeit, Integrität und Vertraulichkeit. Besonders beim Thema Datenschutz (DSGVO) schauen wir genau hin. Es geht nicht nur um Technik, sondern auch um rechtliche Rahmenbedingungen:

- TOMs (Technische und organisatorische Maßnahmen): Sind die Daten physisch und digital geschützt?

- AVVs & Rechtliches: Ist das Vertragswerk sauber?

- Datensparsamkeit: Erheben und verarbeiten wir wirklich nur das, was nötig ist?

3. Nachhaltige Automatisierung im eigenen Tech-Stack

Wir setzen auf Lösungen, die sich nahtlos in deine bestehende Infrastruktur einfügen, statt neue Abhängigkeiten zu schaffen. Viele Agenturen setzen reflexartig auf externe Plattformen wie Make (ehem. Integromat) oder Zapier. Das sehen wir kritisch:

- Datenschutz: Ist es wirklich notwendig – und DSGVO-konform im Sinne der Datensparsamkeit –, Kundendaten für ein kleines Problem an einen Drittanbieter zu senden (inkl. AVV-Management)?

- Skalierbarkeit: Wenn das Problem wächst, stoßen No-Code-Plattformen oft an ihre Grenzen und werden teuer oder unübersichtlich

Unser Weg: Wir nutzen das, was du bereits hast.

- Microsoft 365 Kund:innen: Wir bauen Lösungen direkt in Azure, nutzen Power Automate für Prozesse, Azure SQL für Daten und Power BI für Visualisierungen. Für KI-Aufgaben binden wir Azure OpenAI sicher in deinem Tenant ein. So bleiben alle Daten in deiner Kontrolle und nur ein Ökosystem muss geschützt werden.

- Google Workspace Kund:innen: Wir nutzen Google Apps Script für Prozesslogik, BigQuery als Data Warehouse, Vertex AI für maßgeschneiderte KI-Modelle und Looker Studio für transparente Auswertungen.

- Self-Hosting: Wo nötig, entwickeln wir eigene Node.js-Lösungen (Funktionen, Webhooks, APIs) oder setzen auf n8n, das du selbst hosten kannst – volle Datenhoheit, keine Fremdsteuerung.

Selbst für Systeme ohne eigene Schnittstelle (API) finden wir Wege. Wir integrieren individuelle Logiken, etwa durch Skripte, die Daten direkt aus Datenbanken ziehen und sicher per sFTP oder Webhook in das Automatisierungssystem pushen.

Fazit

Wir erschlagen Probleme nicht blind mit KI oder externen Tools. Wir analysieren, ob du einen Algorithmus für Präzision, ein ML-Modell für Muster, oder ein LLM für Sprache benötigst – und implementieren dies sicher und nachhaltig in deine eigene IT-Landschaft.

Beitrag teilen

Mit dem richtigen Dienstleister zum Erfolg

Der KI-Hype ist groß, doch nicht jede KI passt zu jeder Herausforderung. Wir zeigen euch, wo ChatGPT sinnvoll eingesetzt werden kann und wo spezialisierte Lösungen gefragt sind.

In unserem Blogbeitrag erfahrt ihr, wie ihr KI realistisch bewerten und die richtigen Tools für eure Prozesse auswählt.

Ähnliche Inhalte

Was ist ein CDN?

Barrierefreie Webseite erstellen

Was ist ein Tag Manager?

KI-Hype vs. Realität

Know-How

Der Mehrwert moderner Visitenkarten

Eine Barrierefreiheit Webseite in der Gesetzgebung

Automatisierung im Vergleich

Styleguides im Webdesign

Unsere Leistungen

Digitale Geschäftsprozesse

IT-Sicherheit

Datenstrategie

Online Marketing